Fünf Dinge, die Sie nicht mit ChatGPT teilen sollten

ChatGPT hat sich zu einem der beliebtesten Tools entwickelt, wenn es darum geht, Fragen zu beantworten oder alltägliche Aufgaben zu lösen. Obwohl dieses KI-basierte Tool sehr nützlich sein kann, warnen Forscher davor, dass nicht alles mit ihm geteilt werden sollte.

ChatGPT, das Produkt des Unternehmens Open AI, garantiert vielen Benutzern einen digitalen Assistenten, der Texte schreiben, Code korrigieren, medizinische Ergebnisse analysieren oder sogar helfen kann, ein Kind zum Einschlafen zu bringen. Doch hinter diesen Antworten verbergen sich Algorithmen, die aus jeder Interaktion etwas lernen.

Im Laufe der Jahre wird ChatGPT nicht nur wissen, dass Sie beispielsweise gerne Eier essen und Rückenschmerzen haben, sondern es wird sich auch viel persönlichere Daten eingeprägen.

Tatsächlich zielen Tools wie ChatGPT darauf ab Antworten zu personalisieren, um ihre eigene zukünftige Leistung zu verbessern. Sie speichern individuelle Details, von der körperlichen Verfassung der Benutzer bis hin zu einigen sehr privaten Dingen.

Benutzer können diese Funktion zwar über die Einstellungen deaktivieren, da dies jedoch den meisten Menschen gleichgültig ist, wird dieser GPT-Chat viele Informationen zur Verfügung gestellt bekommen. Aber welche Infos sollten nicht geteilt werden? Und warum?

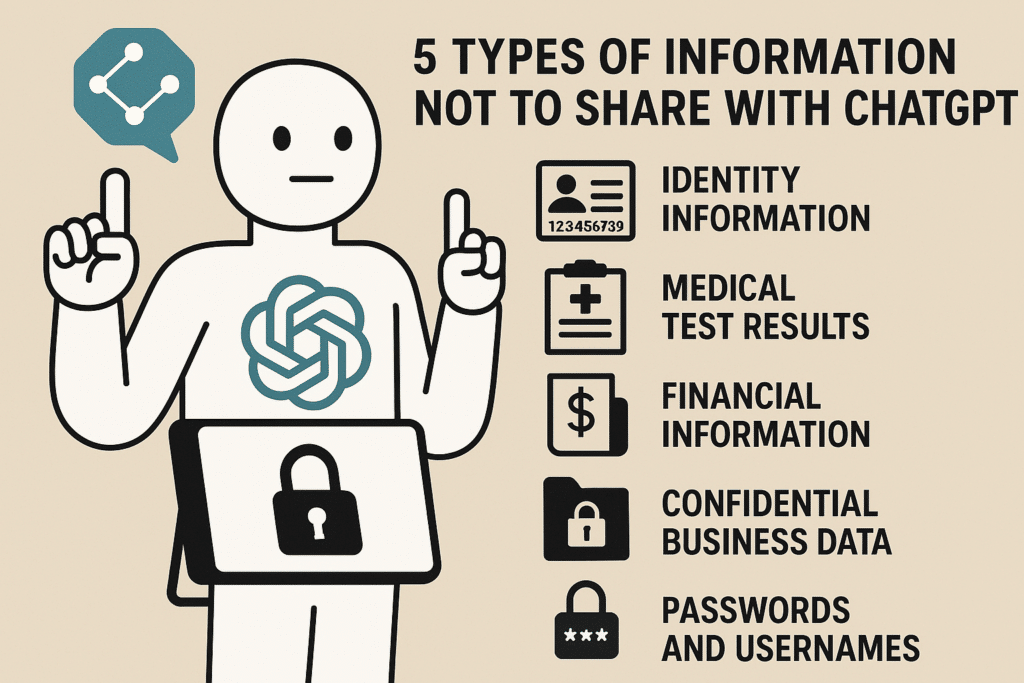

Laut Warnungen von Experten gibt es fünf Arten von Informationen, die nicht in Gespräche mit Chatbots eingegeben werden sollten, weil diese Informationen bei Trainingsmodellen, Systemfehlern oder sogar bei Cyberangriffen missbraucht werden können.

Zu diesen Informationen gehören:

1. Identitätsinformationen: wie Geburtsurkundennummer, Urkunden, Reisepass, Adresse, Telefonnummer und Geburtsdatum. Einige Chatbots versuchen, diese Informationen zu zensieren, aber es gibt keine Garantien.

2. Ergebnisse medizinischer Untersuchungen: Chatbots unterliegen keinen strengen Gesundheitsdatenschutzgesetzen. Laden Sie bei Bedarf nur die Ergebnisse der Tests ohne Identitätsinformationen hoch.

3. Finanzinformationen: Kontonummern, deren Offenlegung schwerwiegende Folgen haben kann.

4. Vertrauliche Unternehmensinformationen: Viele Nutzer verwenden Chatbots, um innerhalb ihrer Arbeit Emails zu schreiben oder Code zu überprüfen. Dabei können vertrauliche Informationen preisgegeben werden.

5. Passwörter und Benutzernamen: Chatbots sind kein sicherer Ort zum Speichern von Zugangsinformationen jeglicher Art. Für Informationen dieser Art gibt es zum Beispiel Passwortmanager.

Große Unternehmen wie Open AI, Google und Microsoft nutzen die Konversationen der Nutzer, um ihre Modelle zu verbessern. Benutzer können die Option in den Einstellungen deaktivieren, damit keine Daten für das Training der Programme verwendet werden, aber viele kennen diese Funktion nicht.

Möglichkeiten zur Wahrung der Privatsphäre

Cybersicherheitsexperten empfehlen, die folgenden Maßnahmen zu ergreifen, um Ihre Privatsphäre zu schützen:

• Temporären Chat-Modus verwenden: Die Funktion „Temporärer Chat“ im Chat funktioniert wie der Inkognito-Modus eines Browsers und verhindert, dass Konversationen gespeichert und in Trainingsmodellen verwendet werden.

• Konversationen löschen: Sie können jede Konversation aus dem Verlauf löschen und sicherstellen, dass die Informationen nach 30 Tagen vollständig gelöscht sind.

• Verwenden Sie Anonymisierungstools: Die Suchmaschine „DuckDuckGo“ hat ein Tool namens Duck.ai bereitgestellt, das Nachrichten anonym an KI-Modelle sendet. Allerdings bietet es im Vergleich zu vollwertigen Chatbots nur begrenzte Möglichkeiten.

Letztlich müssen Sie entscheiden, was Sie mit einem Bot teilen möchten. Chatbots sind zwar so konzipiert, dass sie Konversationen am Laufen halten, aber das letzte Wort haben immer noch Sie.